网站反爬虫的目的和手段

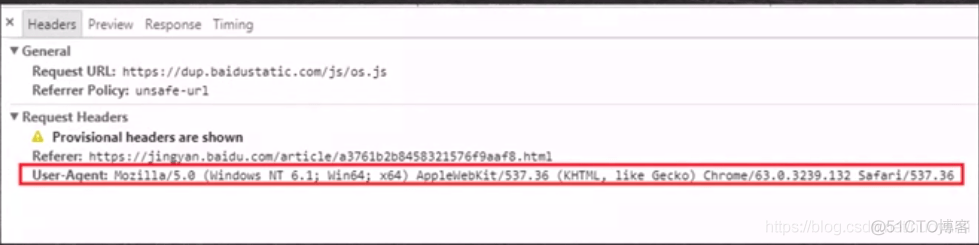

1、通过User-Agent检验反爬

浏览器在发送请求的时候,会附带一部分浏览器及其当前系统环境的参数给服务器,服务器会通过User-Agent的值来区分不同的浏览器。

2、通过访问频度反爬

➢普通用户通过浏览器访问网站的速度相对爬虫而言要慢的多,所以不少网站会利用这一点对访问频度设定一个阈值,如果一个IP单位时间内访问频度超过了预设的阈值,将会对该IP做出访问限制。

➢通常需要经过验证码验证后才能继续正常访问,严重的甚至会禁

止该IP访问网站一段时间。

3、通过验证码检验反爬

有部分网站不论访问频度如何,一定要来访者输入验证码才能继续操作。例如12306网站,不关是登录还是购票,全部都需要验证码验证,与访问频度无关。

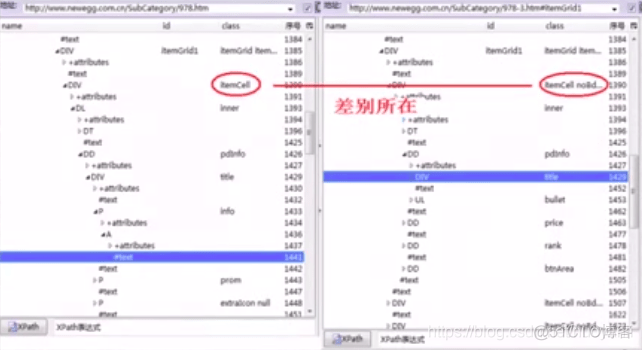

4、通过变换网页结构反爬

一些社交网站常常会变换网页结构,而爬虫大部分情况下都需要通过网页结构来解析需要的数据,所以这种做饭也能起来反爬虫的作业。在网页结构变换后,爬虫往往无法在原本的网页位置找到原本需要的内容。

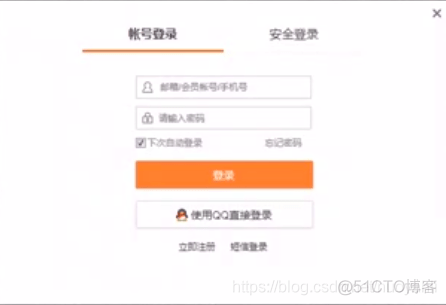

5、通过账号权限反爬

➢部分网站需要登录才能继续操作,这部分网站虽然并不是为了反爬虫才要求登录操作,但确实起到了反爬虫的作用。

➢例如微博查看评论就需要登录账号。

爬取策略制定

针对之前介绍的常见的反爬虫手段,可以制定对应的爬取策略如下。

➢发送模拟User- Agent:通过发送模拟User- Agent来通过检验,将要发送至网站服务器的请 求的User-Agent值伪装成般用户登录网站时使用的User-Agent值。

➢调整访问频度:通过备用IP测试网站的访问频率阈值,然后设置访问频率比阈值略低。这种方法既能保证爬取的稳定性,又能使效率又不至于过于低下。

➢通过验证码校验:使用IP代理,更换爬虫IP;通过算法识别验证码;使用cookie绕过验证码。➢应对网站结构变化:只爬取一次时,在其网站结构调整之前,将需要的数据全部爬取下来;使用脚本对网站结构进行监测,结构变化时,发出告警并及时停止爬虫。

➢通过账号权限限制:通过模拟登录的方法进行规避,往往也需要通过验证码检验。

➢通过代理IP规避:通过代理进行IP更换可有效规避网站检测,需注意公用IP代理池是网站重点监测对象。

神龙|纯净稳定代理IP免费测试>>>>>>>>天启|企业级代理IP免费测试>>>>>>>>IPIPGO|全球住宅代理IP免费测试