对于爬虫我们首先想到的是 python,但是对于前端来说我们通常是 node 来写爬虫,去抓取网站的数据而已。

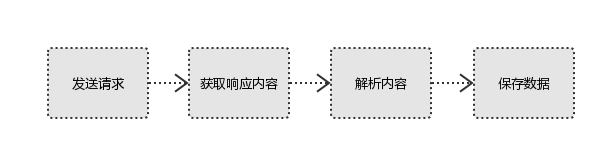

爬虫的基本流程

1、发起请求

使用http库向目标站点发起请求,即发送一个Request,第三方请求库如 request,axios 等。

Request包含:请求头、请求体等

2、获取响应内容

如果服务器能正常响应,则会得到一个Response

Response包含:html,json,图片,视频等

3、解析内容

解析html数据:正则表达式,第三方解析库如cheerio,PhantomJS,JSDom.等

解析json数据:json模块

解析二进制数据:以buffer的方式写入文件。

#4、保存数据

数据库

接下来以爬去腾讯网文章数据为例,首先要知道网站的请求地址是 https://www.qq.com/,根据这个地址我们发送一个请求,得到网站的源代码:

const request = require('request'); const url = 'https://www.qq.com/' const fs = require('fs') const cheerio = require('cheerio') const iconv = require('iconv-lite')

request({url, encoding: null}, (err, response, body) => { let result = iconv.decode(body, 'gb2312'); console.log(result) })

在得到网站源代码的过程中我们发现网站不是 utf8 编码格式的,而是 gb2312 的形式,所以我们借助 iconv-lite 模块解析。

得到了响应的内容之后,我们需要提取 html 中的内容,这次我想抓取网站的新闻标题部分。

const request = require('request') const url = 'https://www.qq.com/' const fs = require('fs') const cheerio = require('cheerio') const iconv = require('iconv-lite')

request({url, encoding: null}, (err, response, body) => { let result = iconv.decode(body, 'gb2312'); let list = [] let $ = cheerio.load(result) $('.yw-list li').each((i, ele) => { let text = $(ele).text().replace(/\s/g, '') list.push(text) }) console.log(list) fs.writeFileSync('qq.json', JSON.stringify(list)) })

提取部分有用的内容之后,通常是保存到数据库中,或者写入到文件系统中。

神龙|纯净稳定代理IP免费测试>>>>>>>>天启|企业级代理IP免费测试>>>>>>>>IPIPGO|全球住宅代理IP免费测试