每日分享:

有一句安慰的话是比上不足,比下有余;但这句话其实安慰不了人,只要常常存着跟别人比较的心 就永远不会快乐

不用一味怨叹自己没朋友,有些人是你运气好,才没跟他们成为朋友

目标:

- 掌握 scrapy的安装

- 应用 创建scrapy的项目

- 应用 创建scrapy爬虫

- 应用 运行scrapy爬虫

- 应用 scrapy定位以及提取数据或属性的方法

- 掌握 response响应对象的常用属性

一、安装scrapy

pip install scrapy

二、scrapy项目开发流程

1. 创建项目:

scrapy startproject mySpider

2. 生成一个爬虫

scrapy genspider itcast itcast.cn

3. 提取数据

根据网站结构在spider中实现数据采集相关内容

4. 保存数据

使用pipeline进行数据后续处理和保存

三、创建项目

通过命令将scrapy项目的文件生成出来,后续步骤都是在项目文件中进行相关操作,下面以抓取传智师资库来学习scrapy的入门使用:传智教育课程培训教研团队

创建scrapy项目的命令:

scrapy startproject 项目名字

例:

scrapy startproject myspider

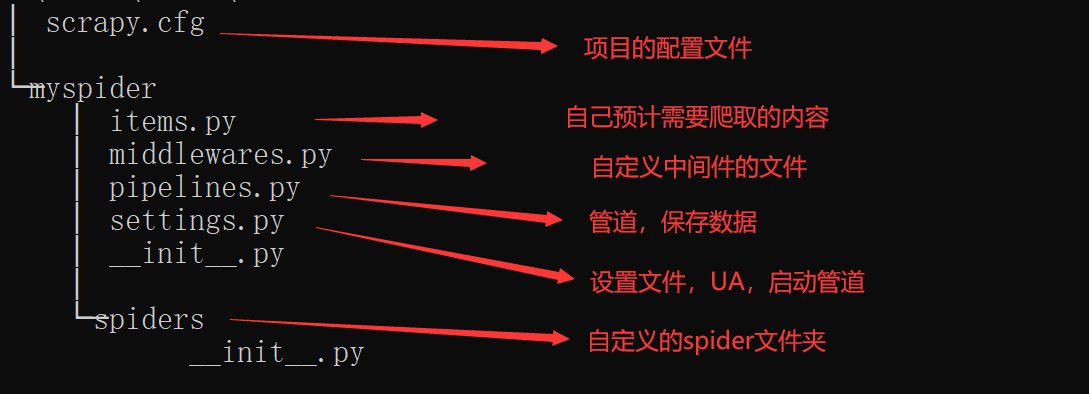

win系统终端使用命令tree/F myspider来查看文件

四、创建爬虫

通过命令创建出爬虫文件,爬虫文件为主要的代码作业文件,通常一个网站的爬取动作都会在爬虫文件中进行编写

终端命令:

在项目路径下执行:

scrapy genspider 爬虫的名字 允许爬取的域名

爬虫的名字:作为爬虫运行时的参数

允许爬取的域名:为对于爬虫设置的爬取范围,设置之后用于过滤要爬取的url,如果爬取的url与允许的域不通则被过滤掉

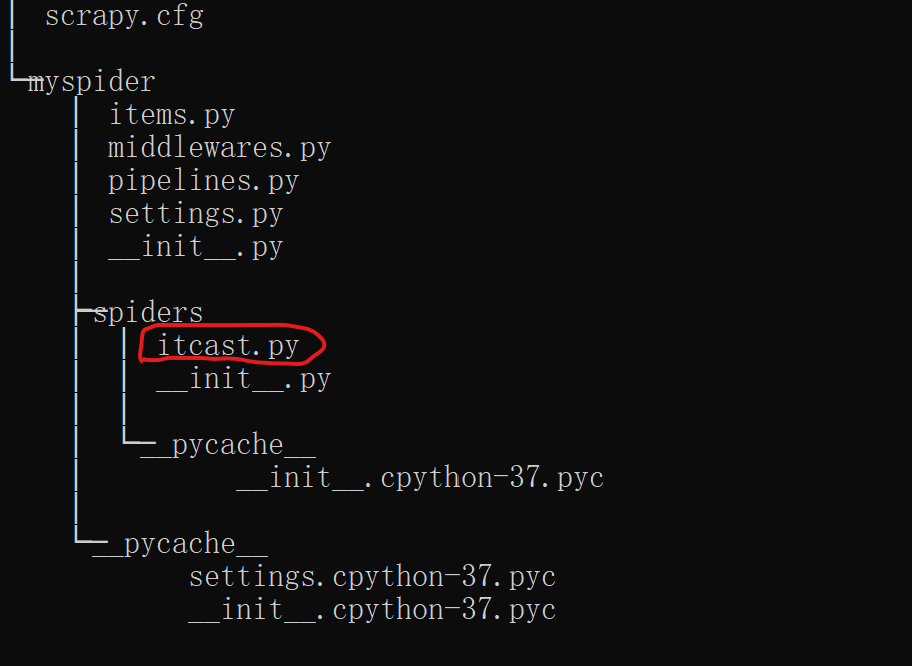

例:

cd myspider

scrapy genspider itcast itcast.cn

生成的目录和文件结果:

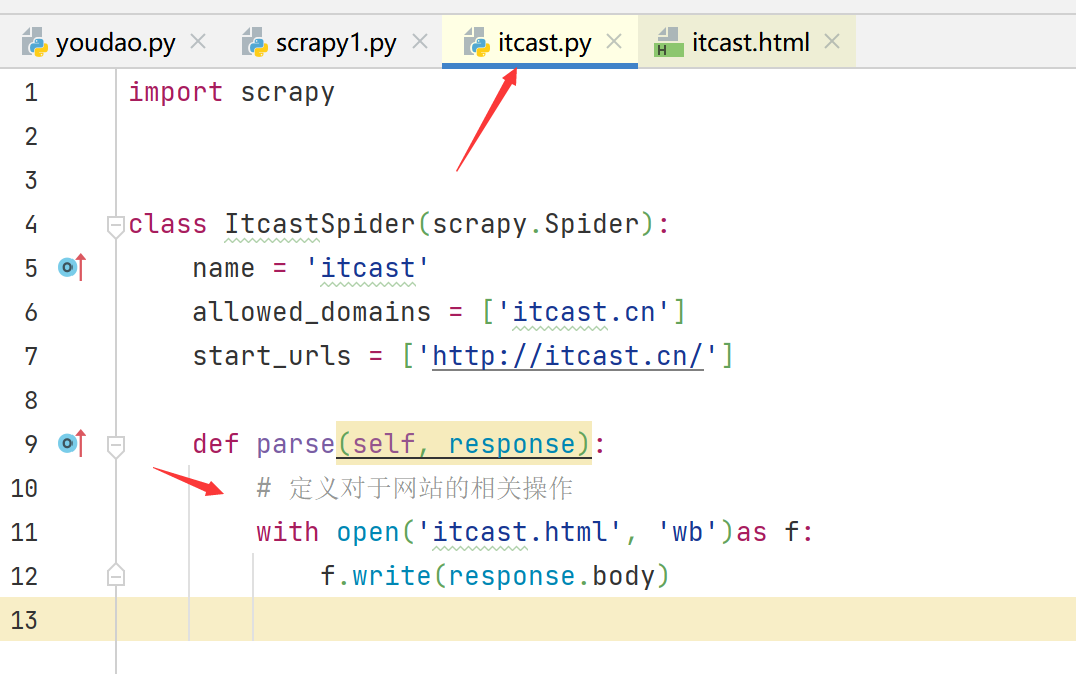

简单使用:

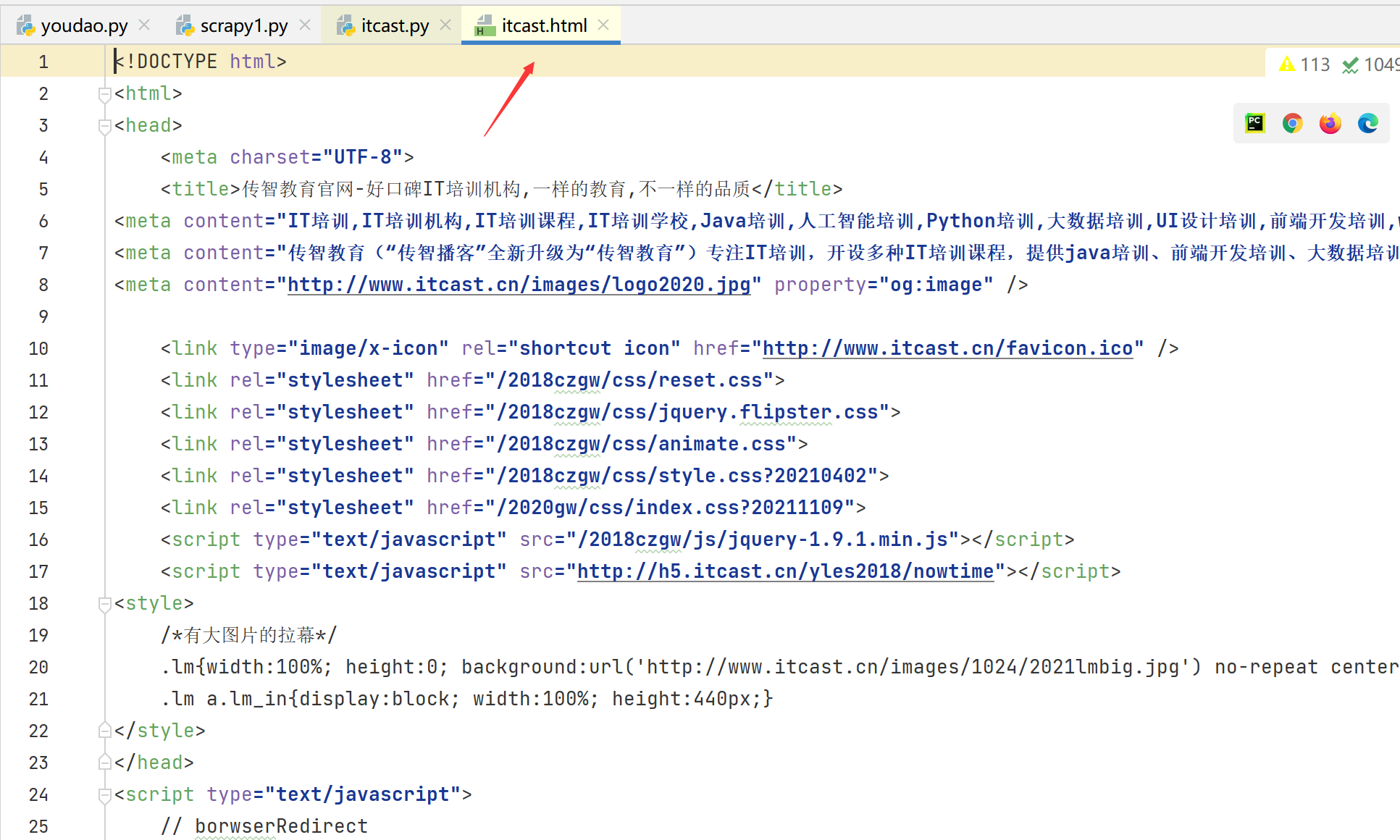

在终端输入命令:scrapy crawl itcast即可运行

之后可以发现,有了itcast.html

五、完善爬虫

在上一步生成出来的爬虫文件中编写指定网站的数据采集操作,实现数据提取

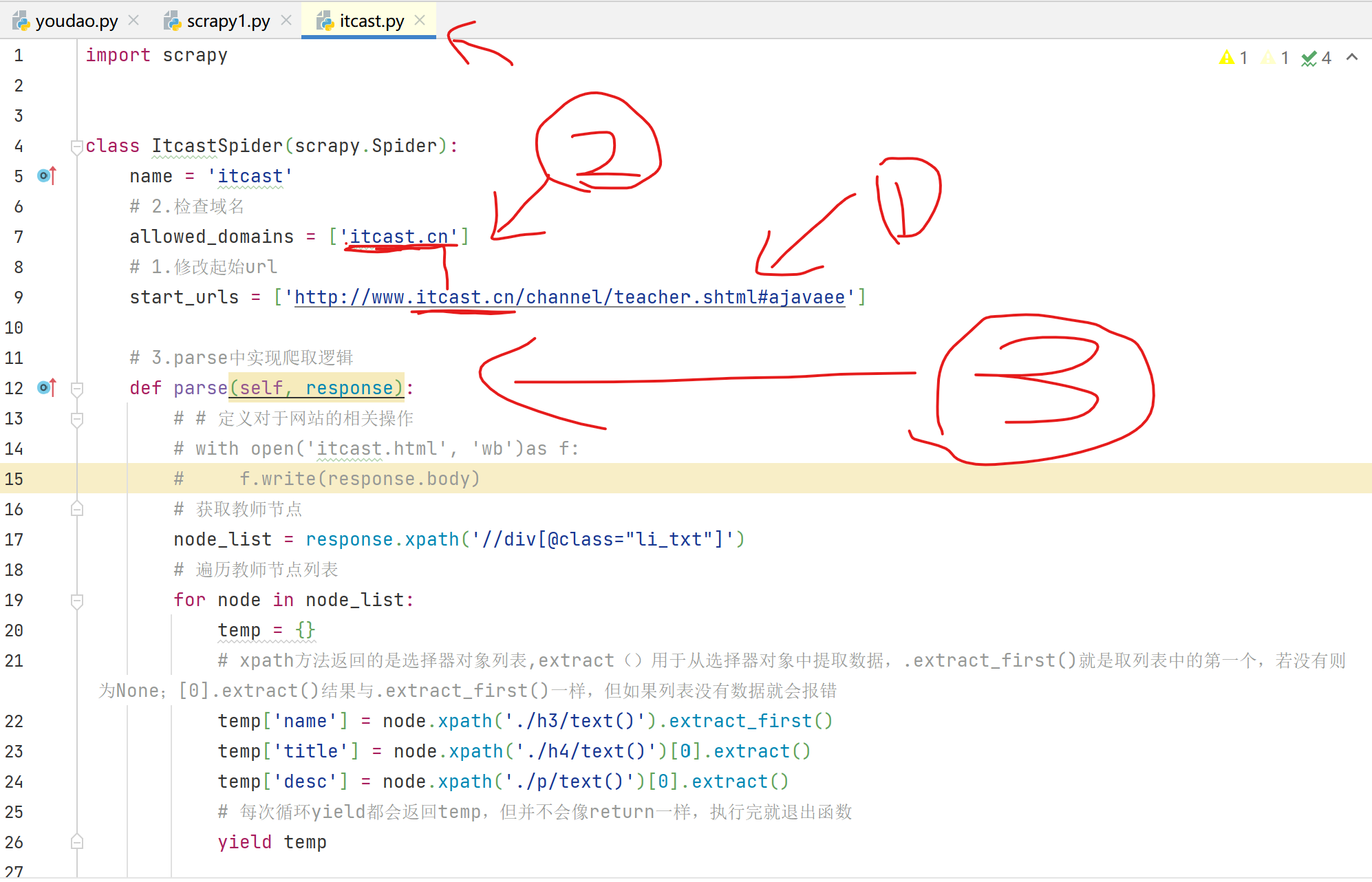

5.1 完善爬虫要修改的内容

修改内容步骤:

1. 修改起始url

2. 检查域名

3. 在parse方法中实现爬取逻辑

步骤1、2、3的解释如下图:

源代码:

import scrapy

class ItcastSpider(scrapy.Spider):

name = 'itcast'

# 2.检查域名

allowed_domains = ['itcast.cn']

# 1.修改起始url

start_urls = ['http://www.itcast.cn/channel/teacher.shtml#ajavaee']

# 3.parse中实现爬取逻辑

def parse(self, response):

# # 定义对于网站的相关操作

# with open('itcast.html', 'wb')as f:

# f.write(response.body)

# 获取教师节点

node_list = response.xpath('//div[@class="li_txt"]')

# 遍历教师节点列表

for node in node_list:

temp = {}

# xpath方法返回的是选择器对象列表,extract()用于从选择器对象中提取数据,.extract_first()就是取列表中的第一个,若没有则为None;[0].extract()结果与.extract_first()一样,但如果列表没有数据就会报错

temp['name'] = node.xpath('./h3/text()').extract_first()

temp['level'] = node.xpath('./h4/text()')[0].extract()

temp['text'] = node.xpath('./p/text()')[0].extract()

# 每次循环yield都会返回temp,但并不会像return一样,执行完就退出函数

yield temp

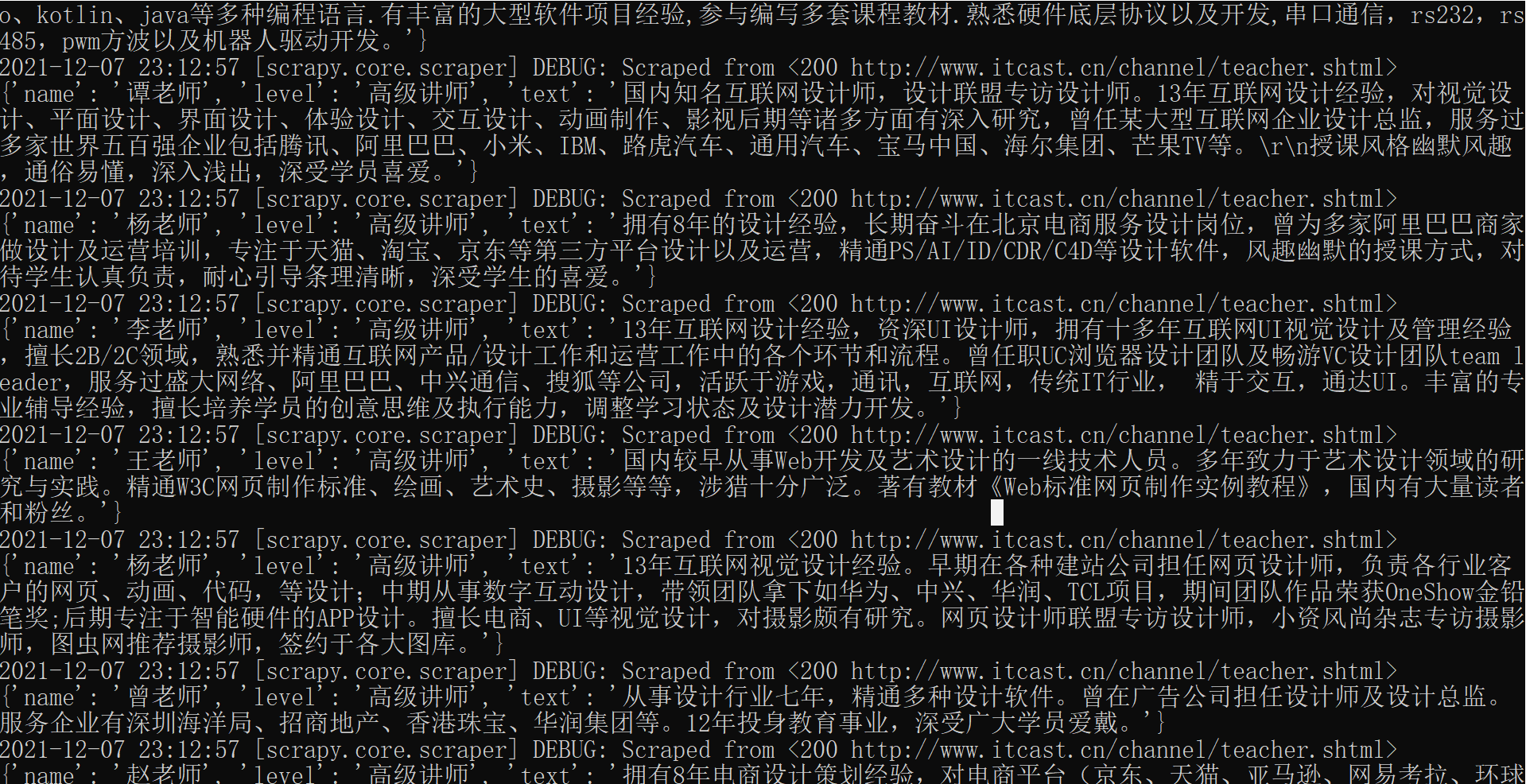

终端中输入命令:scrapy crawl itcast 来运行代码

部分结果示例:

注意:

- scrapy.spider爬虫类中必须有名为parse的解析

- 如果网站结构层次比较复杂,也可以自定义其他解析函数

- 在解析函数中提取的url地址如果要发送请求,则必须属于allowed_domains范围内(也就是说域名必须要在allowed_domains里面,否则会被拦截),但是start_urls中的url地址不受这个限制

- 启动爬虫的时候注意启动的位置,要在项目路径下启动

- parse()函数中使用yield返回数据,解析函数中的yield能够传递的对象只能是:Baseitem,Request,dict,None

5.2 定位元素以及提取数据、属性值的方法

解析并获取scrapy爬虫中的数据,利用xpath规则字符串进行定位和提取

- response.xpath方法的返回结果是一个类似list的类型,其中包含的是selector对象,操作和列表一样,但是有一些额外的方法

- 额外方法extract():返回一个包含有字符串的列表

- 额外方法extract_first():返回列表中的第一个字符串,列表为空没有None

5.3 response响应对象的常用属性

- response.url:当前响应的url地址

- response.request.url: 当前响应对应的请求的url地址

- response.headers: 响应头

- response.requests.headers: 当前响应的请求头

- response.body: 响应体,也就是HTML代码,byte类型

- response.status: 响应状态码

六、保存数据

利用管道pipeline来处理、保存数据

6.1 在pipelines.py文件中定义对数据的操作

- 定义一个管道类

- 重写管道类的process_item方法

- process_item方法处理完item之后必须返回给引擎

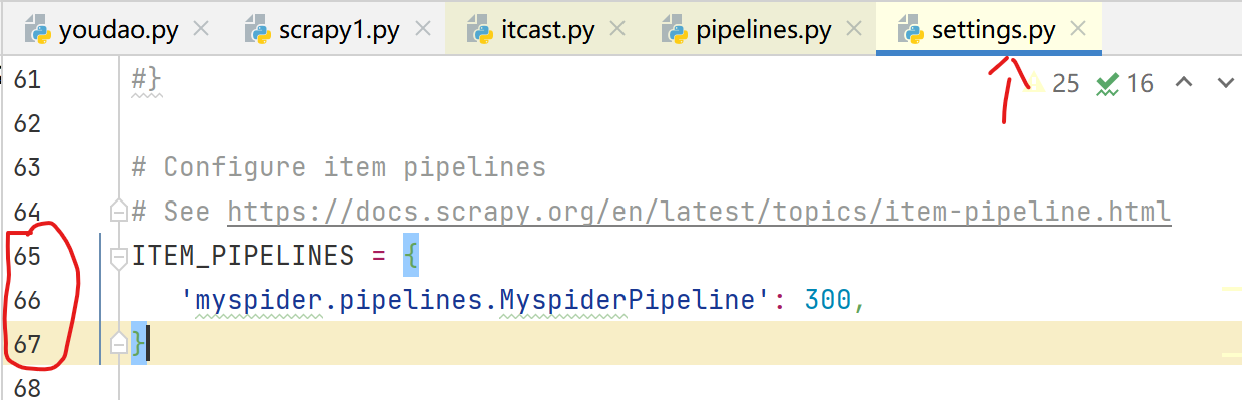

6.2 在settings.py配置启用管道

配置项中键为使用的管道类, 管道类使用.进行分割, 第一个为项目目录, 第二个为文件, 第三个为定义的管道类

配置项中值(例:上图中的300)为管道的使用顺序, 设置的数值越小越优先执行, 该值一般设置为1000以内

6.3 将数据保存在文件

将pipelines.py中的代码改为:

from itemadapter import ItemAdapter

import json

class MyspiderPipeline:

def __init__(self):

self.file = open('itcast.json', 'w')

# 爬虫文件中提取数据的方法每yield一次item,就会运行一次

# 该方法为固定名称函数

def process_item(self, item, spider):

# print(item)

# 将字典数据序列化

json_data = json.dumps(item, ensure_ascii=False) + ',\n'

# 将数据写入文件

self.file.write(json_data)

# 默认使用完管道后需要将数据返回给引擎

return item

def __del__(self):

self.file.close(

七、运行scrapy

命令:在项目目录下执行scrapy crawl 爬虫名字

例:scrapy crawl itcast

神龙|纯净稳定代理IP免费测试>>>>>>>>天启|企业级代理IP免费测试>>>>>>>>IPIPGO|全球住宅代理IP免费测试